So nehmen Sie professionelle HDR-Videos auf

Was ist HDR?

HDR oder „High Dynamic Range“ ist in erster Linie eine Erweiterung des Helligkeitsbereichs, den ein Monitor oder ein Fernseher anzeigen kann. Bis vor kurzem konnten die meisten Fernseher und Monitore keinen sehr großen Helligkeitsbereich anzeigen, in der Regel etwa sechs Stufen. Neue Display-Technologien wie OLED (Organic Light Emitting Diode) und Fortschritte in der LCD-Hintergrundbeleuchtung haben es ermöglicht, Bildschirme zu produzieren, die zehn oder mehr Stufen des Dynamikbereichs anzeigen können. Diese Bildschirme sind nicht nur heller, sondern bieten auch einen besseren Kontrast in den dunkleren Bildbereichen.

Die Bilder oben simulieren den Unterschied, den Sie zwischen einem SDR-Bild (links) und einem HDR-Bild (rechts) sehen können, wenn Sie einen HDR-Fernseher oder -Monitor verwenden. Mit seinem größeren Dynamik- und Farbbereich kann ein HDR-Display ein breiteres Spektrum an Highlights und eine größere Farbpalette darstellen.

Um diesen Clip in höchster Qualität (4K HDR) zu sehen, besuchen Sie diese Seite. Wenn der YouTube-Player ein kompatibles Gerät erkennt, wird ein rotes HDR-Symbol als Option angezeigt. HDR ist jetzt Standard auf den meisten Handys und Fernsehern führender Hersteller, wobei die Unterstützung für HDR stetig zunimmt.

Wie werden Aufnahmen in HDR gemacht?

Viele von uns verwenden HDR-fähige Formate wie Log oder Raw bereits seit vielen Jahren. Um Inhalte zu erstellen, die für HDR geeignet sind, müssen Sie diese in einem Format aufnehmen, das über einen sehr großen Dynamikbereich verfügt. Als ich den Vulkan Fagradalsfjall in Island filmte, habe ich mit einer Kombination der Formate S-Log3 und ProRes Raw von Sony gearbeitet und meine Sony FX6 und FX3 Kameras für den Dreh verwendet. Wenn diese Kameras mit dem Format S-Log3 oder Raw verwendet werden, erfassen sie einen sehr großen Dynamikbereich mit vermutlich mehr als 14 Stufen. Das ist mehr als die besten aktuellen HDR-Fernseher und -Monitore darstellen können und diese Formate ermöglichen es Ihnen, das Bild während der Postproduktion im Grading-Prozess zu bearbeiten, um HDR-Inhalte zu produzieren, die toll aussehen. Viele der Kameras von Sony verfügen auch über einen dedizierten HDR-Modus und in diesem Modus verwenden die Kameras ein Gamma namens „HLG“. HLG ist ein Farbraum, der in HDR-Fernsehern verwendet wird, und Inhalte, die mit HLG aufgenommen wurden, müssen nicht korrigiert werden, denn sie werden direkt von der Kamera in HDR aufgenommen und auf einem entsprechenden HDR-Fernseher in HDR angezeigt.

Ist für HDR eine andere Belichtung erforderlich?

Beim Filmen in HDR ist keine andere Belichtung erforderlich als bei SDR (Standard Dynamic Range). Ich glaube, viele Menschen denken, dass sie für HDR heller belichten müssten, aber in der Regel ist das nicht so. Sie müssen bedenken, dass HDR einen hohen Dynamikbereich bedeutet. Es geht um den Bereich, den Sie erfassen, nicht nur um die Helligkeit. Gesichter, Menschen, Pflanzen und Gebäude sollen in HDR nicht heller sein als in SDR, sie sollten gleich aussehen und gleich belichtet werden. Ein HDR-Fernseher kann jedoch Highlights wie Reflexionen von glänzenden Oberflächen oder einen sehr hellen Himmel anzeigen und gleichzeitig Details und Texturen in den dunklen Schatten darstellen, die normalerweise auf einem SDR-Bildschirm verloren gehen. Der Schlüssel liegt also darin, den mittleren Bildbereich korrekt zu belichten, und dann sollten die sehr hellen und sehr dunklen Bereiche sich von selbst ergeben.

Den Vulkan zu filmen erwies sich als sehr schwierig, da der Boden sehr dunkel, fast schwarz, und die fließende geschmolzene Lava sehr hell war. Es gab sehr wenig dazwischen, anhand dessen sich die Belichtung bestimmen ließ, wie Sie es normalerweise tun würden. Daher habe ich die in die FX6 integrierten LUTs und die s709 LUT ausgiebig genutzt, um optisch eine gute Balance zwischen der dunklen festen Lava und der leuchtend hellen geschmolzenen Lava zu finden. Ich habe auch das Oszilloskop verwendet, um meine Aufzeichnungsebenen zu messen, da ich so sicherstellen konnte, dass sie Belichtung nicht zu hell oder zu dunkel war.

Das erste Bild unten ist das Bild in S-Log3, das von der Kamera aufgenommen wurde. Das zweite und dritte Bild simulieren den Unterschied zwischen einer Korrektur zu SDR (zweites Bild) und einer Korrektur zu HDR (drittes Bild), wenn die Bilder auf einem SDR- bzw. HDR-Monitor oder -Fernseher angezeigt werden. Der mittlere Bildbereich der beiden korrigierten Bilder unterscheidet sich kaum. Das HDR-Bild weist jedoch einen höheren Helligkeitsbereich auf und in Folge dessen erscheinen die Highlights im HDR-Bild auf einem HDR-Display deutlich heller.

Wie werden Aufnahmen zu HDR korrigiert?

Meine bevorzugte Methode für das Graden zu HDR ist die Verwendung einer Grading-Software, die einen farbverwalteten Workflow verwendet. In einem farbverwalteten Workflow können Sie das Format festlegen, in dem Sie Ihre Aufnahmen erstellt haben, und das Format, in dem Sie Ihre Aufnahmen bereitstellen möchten. In vielen Fällen ist die Software in der Lage, die Metadaten in der aufgenommenen Videodatei zu lesen, um zu ermitteln, welches das Aufnahmeformat ist. Immer häufiger erkennt die Software heutzutage außerdem, welche Art von Display Sie haben. Sie kann dann das aufgenommene Material entsprechend der Art und Weise, wie es angezeigt wird, umwandeln. Natürlich benötigen Sie einen HDR-Monitor oder -Fernseher, um Ihr Ergebnis in HDR anzuzeigen. Sie können keinen SDR-Fernseher oder -Monitor verwenden, wenn Sie wirklich gut aussehende HDR-Inhalte bereitstellen möchten.

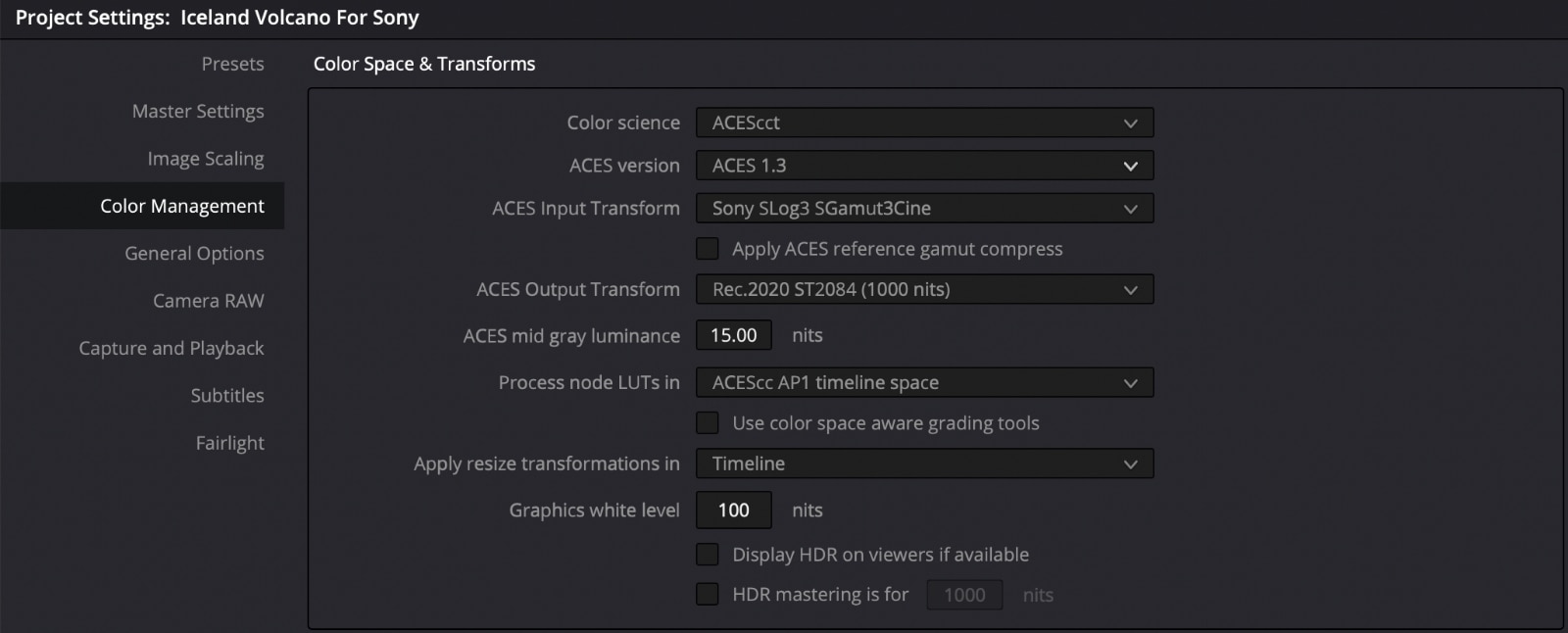

Abbildung unten: Die Farbmanagement-Einstellungen in DaVinci Resolve für einen Workflow von ACES S-Log3 zu HDR.

Wie wichtig sind farbverwaltete Workflows?

Diese Art von Workflow wird in den kommenden Jahren immer wichtiger werden, da die Notwendigkeit, sowohl SDR als auch HDR-Inhalte bereitzustellen, zunimmt. Ich verwende DaVinci Resolve für meine Farbkorrektur und den integrierten farbverwalteten Workflow in ACES. ACES ist das „Farbcodierungssystem der Academy of Motion Pictures“. Es wurde entwickelt, um einen einheitlichen farbverwalteten Workflow zu bieten, der in viele verschiedene Bearbeitungs- und Grading-Anwendungen integriert werden kann. In Resolve und ACES verwende ich die Farbmanagement-Einstellungen und teile ACES so mit, dass ich die Aufnahme mit S-Log3 gedreht habe und das Material in HDR bereitstellen möchte. Die Software nimmt all die komplexen Umwandlungen vor, die erforderlich sind, damit die Aufnahme in HDR angezeigt werden kann. Sie müssen keine Lookup-Tabellen (LUTs) oder anderen Tools verwenden. Die Software übernimmt die ganze harte Arbeit für Sie. Anschließend nehme ich beim Grading der Videoaufnahme den Feinschliff für den finalen Look vor. Wenn ich dann eine SDR-Version benötige, muss ich nur in Resolve/ACES angeben, dass die Ausgabe in SDR/Rec709 anstatt in HDR erfolgen soll. Schon erhalte ich anstelle einer HDR-Ausgabe eine SDR-Ausgabe. Farbmanagement-Tools sind mittlerweile in die meisten hochwertigeren Bearbeitungs- und Farbkorrektursysteme integriert, darunter Adobe Premiere und Final Cut Pro.

Wie werden HDR-Inhalte bereitgestellt?

Dies ist ein Bereich, in dem wir im Moment viele Veränderungen erleben. Noch vor vier oder fünf Jahren gab es kaum HDR-Displays. Heute sind sie überall vertreten. Die meisten hochwertigen Telefone haben heute HDR-Bildschirme. HDR-Fernseher sind mittlerweile gängig und nicht wesentlich teurer als SDR-Fernseher in ähnlicher Qualität. Auch Computer halten mit dieser Entwicklung Schritt und HDR-Displays sind mittlerweile in immer mehr Laptops integriert. Dennoch verfügt nicht jeder über HDR-Bildschirm und wenn HDR-Inhalte auf einem SDR-Bildschirm anzeigt werden, ohne sie zu konvertieren, sieht das irgendwie falsch aus. Glücklicherweise bieten Plattformen wie YouTube jetzt die Möglichkeit, ein in HDR hochgeladenes Video in SDR zu konvertieren, sodass ein Betrachter mit SDR-Display den Clip im SDR wiedergeben kann. Wer ein HDR-Display hat, sieht den Clip in HDR. Damit dies funktioniert, müssen Plattformen wie YouTube wissen, dass der Clip in HDR ist. Diese Information ist in den Metadaten zu finden.

HDR-Metadaten

Metadaten sind „Daten über Daten“ und eine Videodatei wird bei der Verschlüsselung mit vielen Metadaten versehen. Einer der großen Vorteile von farbverwalteten Workflows besteht darin, dass die Codierungssoftware – innerhalb eines farbverwalteten Workflows – beim Codieren einer Datei in der Regel die richtigen Metadaten-Tags hinzufügt, die die Datei als HDR kennzeichnen. Die Metadaten kennzeichnen die Datei nicht nur als HDR, sondern geben auch Auskunft über den speziellen HDR-Typ anhand von Informationen über das Ziel-Gamma und den Farbraum. Wenn ich DaVinci Resolve verwende, um eine Datei entweder aus Academy Color Encoding System (ACES) oder dem eigenen farbverwalteten Workflow von Resolve zu exportieren, fügt der Encoder standardmäßig automatisch Metadaten-Tags hinzu, die den Einstellungen für das Zielformat des Projekts entsprechen. Auf diese Weise weiß YouTube, wenn ich den fertigen Clip auf YouTube hochlade, dass er in HDR ist und auf welcher Art von Display ich ihn während des Gradings angezeigt habe. Anhand dieser Informationen kann YouTube dann die Datei in andere Anzeigestandards konvertieren – egal, ob Betrachter also über ein HDR-Display oder ein SDR-Display verfügen, es wird immer ein korrekt aussehendes Bild angezeigt, obwohl ich nur eine einzige HDR-Datei hochgeladen habe.

Codec-Wahl für HDR

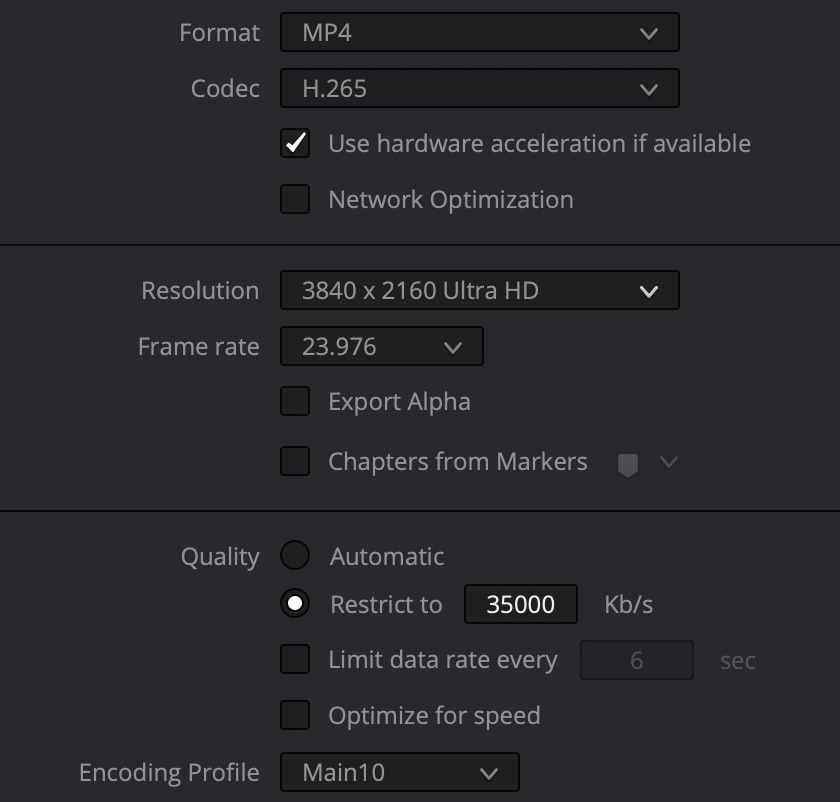

Zusätzlich zu den Metadaten müssen Sie auch einen sehr hochwertigen Codec anwenden, vorzugsweise einen 10-Bit-Codec. Der Grund hierfür ist, dass der größere Dynamikbereich und der höhere Kontrast eines HDR-Bildes schneller zu Problemen bei der Komprimierung führen. Einer der für die Verteilung von HDR-Videoclips am häufigsten verwendeten Codecs ist H.265. H.265 ist ein 10-Bit-Codec, der eine sehr effiziente Komprimierung verwendet, um die Dateigröße sehr kompakt zu halten. Die meisten HDR-Fernseher können H.265-codierte Videoclips direkt von einem USB-Stick wiedergeben, der an den Fernseher angeschlossen ist. Plattformen wie YouTube, Vimeo usw. unterstützen alle H.265 und selbst bei niedrigen Bitraten bleibt die Qualität sehr hoch. Ich codiere meine 4K-H.265-Dateien mit 35 MB/s, da dies die höchste H.265-Bitrate ist, die viele HDR-Fernseher unterstützen.

Sehen Sie sich das Bild zu den Codierungseinstellung an, die ich für das HDR-Video des Vulkans verwendet habe.

HDR für heutige Anwendungen

HDR wird der neue Standard werden. In naher Zukunft wird HDR normal sein und SDR wird der Vergangenheit angehören. Da dies nicht über Nacht geschehen wird, wird die Notwendigkeit, Inhalte in HDR bereitzustellen, stetig wachsen, während immer mehr Geräte mit HDR-Bildschirmen ausgestattet sein werden und Benutzer nach HDR-Inhalten in höherer Qualität verlangen werden. Gleichzeitig wird es immer einfacher, tolle HDR-Inhalte aufzunehmen und bereitzustellen. Für Filmemacher bedeutet dies, Neues zu erlernen. Sie müssen beispielsweise dafür sorgen, dass ihre Inhalte die richtigen Metadaten beinhalten, aber sobald sie dies erlernt haben, ist die Bereitstellung in HDR nicht schwieriger als in SDR. Für mich HDR kommt das Video des Vulkans Fagrasdalsfjall in HDR dem, was ich tatsächlich gesehen habe, als ich dort war, deutlich näher als in SDR. In meinen Augen besteht also kein Zweifel daran, dass Menschen meine Aufnahmen genau so sehen sollten.

Wenn Sie mehr über diesen Dreh erfahren möchten, lesen Sie meinen Artikel 4 Seasons In A Day And A Red Hot Volcano (Vier Jahreszeiten an einem Tag und ein brodelnder Vulkan).